近日,阿布扎比的全球领先技术研究中心 TII 发布了一款世界顶级开源大模型 ——Falcon180B。这款模型在3.5万亿 token 的训练下,拥有1800亿参数,性能超过了之前的开源模型 Llama2,甚至接近了谷歌的 GPT-4。Falcon180B 在各项任务中表现出色,被认为是目前最好的开源大模型之一。

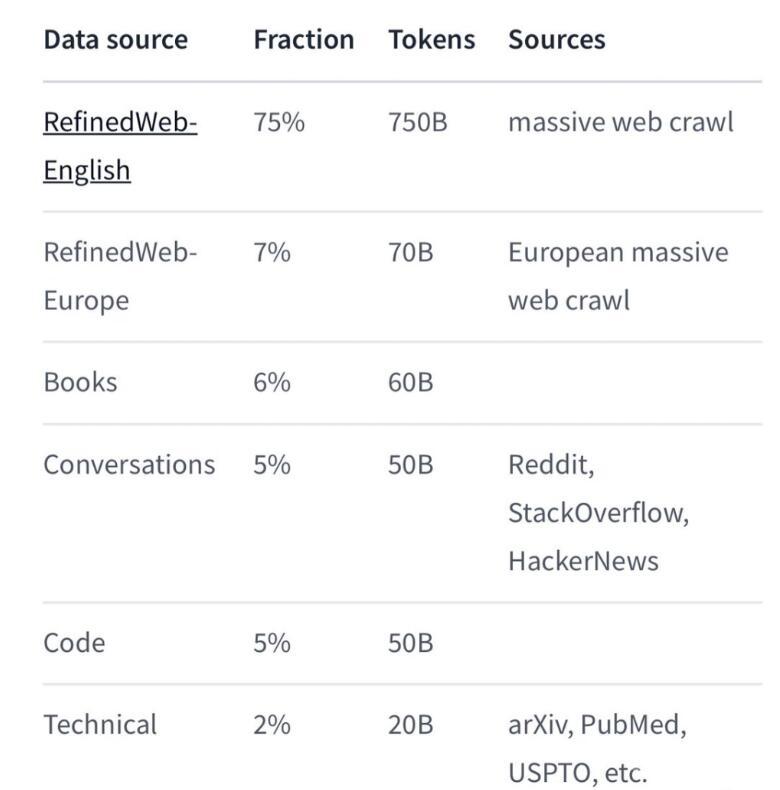

Falcon180B 的训练过程使用了亚马逊云机器学习平台,并在多达4096个 GPU 上完成了训练,总共进行了大约7,000,000个 GPU 计算时。训练数据主要来自于 RefinedWe 数据集,其中包括对话、技术论文和一小部分代码等多种数据。

项目地址:https://huggingface.co/tiiuae/falcon-180B-chat

Falcon180B 在多个基准测试中都表现出色,超过了 Llama2和 GPT-3.5。在 Hugging Face 开源大模型榜单上,Falcon180B 的评分也超过了 Llama2,成为当前评分最高的开放式大模型。

除了基础模型,研究人员还发布了聊天对话模型 Falcon-180B-Chat,该模型在对话和指令数据集上进行了微调,可以进行实时对话的演示。

虽然 Falcon180B 的性能引起了广泛关注,但也有一些人对其质疑。英伟达高级科学家 Jim Fan 指出,Falcon-180B 的训练数据中代码只占了5%,而代码是提高模型推理能力的重要数据,因此对于没有代码能力的模型,无法声称优于 GPT-3.5或接近 GPT-4。

总的来说,Falcon180B 作为世界顶级开源大模型,拥有强大的性能和参数规模,在各项任务中表现出色。然而,对于其在代码方面的不足,还需要进一步的探讨和研究。

还没有评论,来说两句吧...