今天凌晨,一年一度的 Meta Connect 大会上发布了一系列以 AI 为重点的公告。

不只有最新的 MR 耳机、与 Ray-Ban 合作打造的智能眼镜,最重要的是,Meta 将在自身的所有通讯类 App、Meta Quest 3 和未来的 Ray-Ban Meta 智能眼镜中内置生成式 AI 技术驱动的新功能,从多轮对话的 AI 助手到图像编辑等一应俱全。

所有这些发布涉及的 AI 技术均基于 Llama 2—— 迄今为止最强大的开源大模型。不过 Meta 也提前透露了,更强大的 Llama 3 将于 2024 年推出。

Meta 还在 Connect 大会上宣布了全新的图像生成器 Emu,它将用于为 AI 贴纸和图像编辑等功能提供支持。

Meta 版聊天机器人「Meta AI」问世

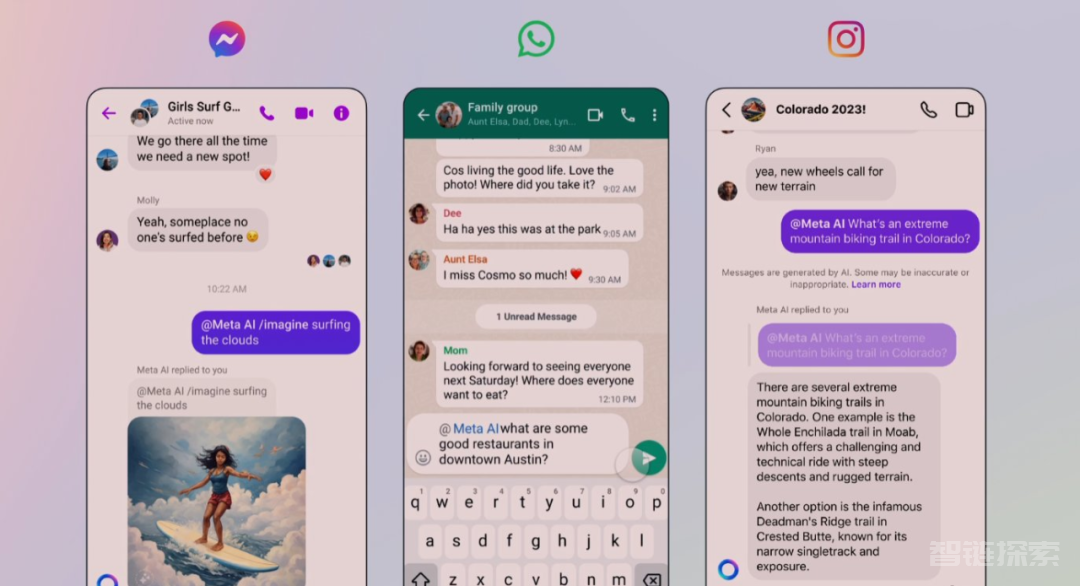

大模型出现后,科技公司都在推出一系列新的人工智能机器人,引领开源一方的 Meta 也不例外,其正在其消息应用程序中推出一系列新的人工智能机器人,包括 WhatsApp、Messenger 和 Instagram。从本周三起,全新上线的大模型能力可供美国的部分测试版用户使用。

扎克伯格展示 Meta 版 ChatGPT

这个名为 Meta AI 的人工智能助手,看起来与 OpenAI 的 ChatGPT 和 Anthropic 的 Claude 2 等聊天机器人非常相似。

扎克伯格表示,用户现在已经可以通过群聊接受大模型的帮助,与朋友计划旅行、收获知识问题回答,并通过微软的 Bing 搜索互联网以提供实时网络结果。

与此前 Facebook 的虚拟助手 M 不同,定制的 Meta AI 助手面向更广大的用户群体,而且是完全自动化的,其模型可以参考之前的对话,经过调整可以给出「非常简洁」的答案。

这意味着最新的 AI 助手需要拥有强大的上下文学习能力。关于如何实现,Meta 也在一篇新论文中介绍了背后的技术:

论文地址:https://ai.meta.com/research/publications/effective-long-context-scaling-of-foundation-models/

在上面这篇论文中,Meta 通过持续预训练 LLAMA 2 checkpoints 来构建模型,并使用了额外的 4000 亿个 token 作为长训练序列。在该系列模型中,较小规模的 7B/13B 变体使用了 32768 个 token 序列进行训练,而 34B/70B 变体则使用了 16,384 个 token 序列。

与现有研究进行的有限评估不同,Meta 使用语言建模、合成任务以及涵盖长短语境任务的各种实际基准对我们的模型进行了广泛评估。在语言建模方面,Meta 的模型在上下文长度方面表现出明显的幂律缩放行为。这种缩放行为不仅表明该模型能够持续从更多语境中获益,还表明语境长度是缩放 LLM 的另一个重要轴心。在研究基准上将新模型与 LLAMA 2 进行比较时,我们不仅能观察到在长语境任务上的显著改进,而且还观察到在标准短语境任务上的适度改进,尤其是在编码、数学和知识基准上。

研究人员探索了一种简单而经济有效的方法,在没有任何人工标注数据的情况下,对持续预训练的长模型进行指导性微调。最终的结果是,在一系列长语境基准测试中,聊天模型的整体性能超过了 gpt-3.5-turbo-16k,这些基准测试包括问题解答、摘要和多文档聚合任务。

目前,Meta AI 可以在任何聊天中调用。与 ChatGPT 接入 DALLE・3 能力类似,Meta AI 可以利用自家的图像生成模型 Emu 来生成带水印的图像。

除了 Meta AI 之外,Meta 今天还推出了一系列「AI 角色」—— 大模型可以模仿某些名人的个性,包括 Kendall Jenner、德维恩・韦德、MrBeast、帕丽斯希尔顿、Charli D'Amelio 和 Snoop Dogg,其他机器人,包括贝尔・格里尔斯(Bear Grylls)、Chloe Kim 和 Josh Richards 正在路上。与 Meta AI 一样,聊天机器人也存在于 Meta 的消息应用程序中,它们有个人资料图像和时间线,就像真人一样。当你与他们聊天时,化身会根据对话巧妙地产生动画。

Meta 表示,为了保证安全性,其在发布模型之前花费了 6000 个小时寻找有问题的用例并招募员工在内部与模型进行交互。它还声称已经开发了新技术来捕获违反其政策的内容并对其采取行动,阻止 Meta AI 以外的聊天机器人搜索网络。

图像生成领域又一选手:Emu

在大会上,扎克伯格还介绍了全新的图像生成模型「Emu」。

Emu(鸸鹋)的命名方式延续了 Meta 的动物主题。这是 Meta 对 DALL-E 和 MidJourney 等爆火应用程序的正式回应,同时推出的还有「生成式 AI 表情」和「图像编辑」两个重点新功能。

由 Emu 提供支持的新功能将允许用户在几秒钟内创建独一无二的 AI 表情,不久后就将登陆 WhatsApp、Messenger、Instagram 甚至 Facebook Stories 等 Meta 旗下的应用程序。

扎克伯格表示:「人们每天都会发送数以亿计的表情来表达聊天内容。每一次聊天都是不同的,人们想表达的情绪也有微妙的不同,但现在我们只有固定数量的表情。有了 Emu,你就可以随意输入想要的东西了。」

具体来说,想使用这一功能,用户可以在文本框中输入想看到的图片:

Meta 表示,生成多个即时分享选项平均需要三秒钟。

此外,Meta 还即将在 Instagram 应用程序中推出「图像编辑」功能。用户可以改造自己的图片,或与朋友共同创建 AI 生成的图片,同样由 Emu 的技术提供支持。

以「风格重塑」(Restyle)选项为例,通过输入「水彩」或更详细的提示词,用户可以改造图片的视觉风格:

现场,扎克伯格演示了对自己的狗狗「Beast」照片的编辑,将其变成了折纸和十字绣的风格:

再比如,利用「背景」(Backdrop)选项,用户可以通过提示词来改变图像的场景或背景:

在最新公布的论文中,Meta 也介绍了 Emu 背后的技术细节:

论文地址:https://ai.meta.com/research/publications/emu-enhancing-image-generation-models-using-photogenic-needles-in-a-haystack/

具体来说,Meta 在 11 亿的图像 - 文本对上预训练了一个潜在扩散模型 (LDM),并在从大量图像语料库中手工挑选出的几千张高质量图像上对模型进行了质量调整。鉴于图像选择的标准具有主观性和文化依赖性。Meta 在此过程遵循了一些常见的摄影原则,包括但不限于构图、照明、色彩、有效分辨率、焦点和故事性。

通过对潜在扩散架构进行一些优化,Meta 建立了一个强大的预训练模型,并通过质量调整大大提高了生成图像的视觉吸引力,也就是 Emu。在视觉吸引力方面,Emu 的表现明显优于当前的开源 SOTA 模型 SDXL v1.0 ,如下图所示。

此外,Meta 还验证了质量调整是一种通用方法,对像素扩散和遮罩生成 Transformer 模型同样有效。

Meta AI 接入微软必应网络搜索

我们知道,自 AI 大模型火爆以来,OpenAI 与微软的合作可称得上是迅速、紧密且全面,从搜索引擎到办公软件,不一而足。

此次,Meta 也寻求自身与微软的进一步合作,在 Meta AI 聊天体验中接入了微软必应网络搜索。此前 7 月,Meta 和微软就曾宣布在 Windows 和 Azure 上支持 Llama 2 系列大语言模型。

微软 CEO 纳德拉分享微软与 Meta 合作的消息

微软副总裁兼消费者首席营销官 Yusuf Mehdi 介绍了双方的合作。他表示,微软与 Meta 合作,将必应集成到 Meta AI 的聊天体验中,通过访问实时搜索信息来提供更即时、最新的答案。我们来看扎克伯格在现场的演示。

除了 Meta AI 聊天机器人,必应还将集成到 Meta 的其他产品,比如在 WhatsApp、Messenger 和 Instagram 中发送消息。

图源:推特 @AmadeusSVX

双方的合作将加速 AI 时代的创新,未来将持续拓展合作关系,为人们常用的产品提供更强大、有用的 AI 体验。

对于 Meta 与微软的合作,有网友做了一些有趣的梗图,比如「杀死 OpenAI」。

还没有评论,来说两句吧...